Sicheres MCP:

Heute schon Realität

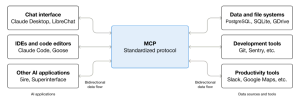

MCP ersetzt individuelle, proprietäre Verbindungen für jede Datenressource und hat sich dadurch schnell als beliebter Standard im gesamten Spektrum der KI durchgesetzt. Das folgende Diagramm aus dem GitHub von MCP zeigt einige Beispiele:

Der Kommunikationsprozess des MCPs baut auf vier grundlegenden Entitäten auf: dem Host, dem Client, dem Server und der Ressource. Im Prinzip ist der Host die KI-Anwendung selbst, die für die Nutzung von MCP konzipiert wurde. Wenn dieser Host mit einer benötigten Ressource kommunizieren muss, erzeugt er einen Client. Dieser Client übernimmt die Interaktion mit dem MCP-Server, welcher wiederum mit der gewünschten Ressource verbunden ist. Die Aufgabe des Servers ist es, die unterschiedlichen Kontextarten bereitzustellen, die die Ressource anbieten kann. Dazu gehören diverse Funktionen (etwa Datei- oder Datenbankoperationen und API-Aufrufe), Datenquellen (wie Inhalte von Dateien, Datenbanken, oder API-Antworten) sowie promptbasierte Workflows (wie die Interaktion mit einem Large Language Model). Das MCP wurde ursprünglich von Anthropic im November 2024 eingeführt und ein Jahr später, im Dezember 2025, an die Linux Foundation gespendet.

Was steckt hinter dem MCP-Boom?

Die plötzliche Beliebtheit des Model Context Protocols lässt sich mit nur einem Wort zusammenfassen: Agenten. Damit diese Software-Agenten mehr als nur Fragen beantworten und wirklich sinnvolle Aufgaben erledigen können, müssen sie in der Lage sein, mit externen Ressourcen zu interagieren. Genau hier setzt MCP an: Es beseitigt die enorme Komplexität, die Agenten dazu zwingen würde, für jede interessante Ressource eine spezielle, eigene Codierung zu entwickeln. Tatsächlich ist es größtenteils dem MCP zu verdanken, dass sich derzeit unzählige Agenten im Internet verbreiten.

Vor der Einführung des MCPs waren KI-Anwendungen darauf angewiesen, APIs zu nutzen, um mit Ressourcen zu kommunizieren. Das erklärt die bekannten Eins-zu-Eins-Beziehungen zwischen Anwendungen und Large Language Models (LLMs), die es heute gibt: ChatGPT verbindet sich mit OpenAI-Modellen, Claude mit Anthropic-Modellen, Gemini mit Google-Modellen und so weiter. Jede dieser Anwendungen implementiert exakt die APIs, die nur für die Interaktion mit ihren spezifischen, zugehörigen Modellen nötig sind – und keine anderen.

Man stelle sich vor, Agenten müssten APIs für Dutzende unterschiedlicher LLMs und eine unbegrenzte Zahl an Funktionen und Datenquellen implementieren. Es wäre unmöglich, sie effizient zu erstellen! Wenn APIs bereits eine Abstraktionsebene über Objekten niedrigerer Ebene darstellen, dann bietet MCP eine weitere, höhere Abstraktionsebene, nämlich über den APIs selbst.

Angesichts dieser Vorteile haben Ressourcen-Entwickler schnell reagiert und MCP-Server veröffentlicht. Sie ermöglichen es Agenten, ihre Ressourcen zu nutzen, zu skalieren und wiederzuverwenden, ohne dass dafür eine kundenspezifische Logik erforderlich wäre. Heute haben fast alle großen LLM-Anbieter und Anbieter von SaaS-Anwendungen ihre Produkte MCP-Server-fähig gemacht.

Im Kontext dieser Entwicklung gewinnt auch Agent-2-Agent (A2A) zunehmend an Bedeutung – ein weiteres Protokoll, das einen Standard für die direkte Interaktion zwischen Agenten definiert. Google kündigte A2A im April 2025 an und spendete es bereits im Juni 2025 an die Linux Foundation. Sowohl MCP als auch A2A werden in unserer von KI geprägten Zukunft eine entscheidende Rolle spielen – und Forscher haben leider auch schon Wege gefunden, das A2A-Protokoll auszunutzen.

Doch wie sicher ist MCP?

Die frühen Inkarnationen des MCPs schenkten dem Thema Sicherheit kaum Beachtung. Das wurde schnell zum Problem. Untersuchungen von Backslash Security im Juni 2025 und Knostic im Juli 2025 legten offen, was Fachleute beunruhigte: Tausende von MCP-Servern waren über das Internet erreichbar und gaben die Inhalte ihrer Ressourcen freimütig heraus. Nicht authentifizierte Anfragen enthüllten Details über die Server, einschließlich der genauen Fähigkeiten der angeschlossenen Ressourcen, die sich im laufenden Produktionsbetrieb befanden! Leider sind falsch konfigurierte MCP-Server im Netz weit verbreitet. Dazu zählen lokale Server, die für ganze Netzwerke zugänglich sind, oder gar solche, die die Ausführung beliebiger Befehle zulassen.

Angreifer können diese Schwachstellen ausnutzen: Sie verstecken Anweisungen, um das Verhalten von Ressourcen zu manipulieren, ersetzen eine bösartige Ressource während der Laufzeit, spähen sensible Informationen aus oder schaffen dauerhafte Hintertüren. Dies mündet in Prompt-Injektionen und Context Poisoning, wodurch die LLM-Ausgabe auf böswillige Weise manipuliert wird.

Im Juni 2025 reagierte das MCP-Projekt und fügte eine Autorisierungsschicht hinzu. Diese soll nach den Konventionen von OAuth 2.1 „Vertrauen zwischen MCP-Clients und MCP-Servern aufbauen„. Das Projekt beschreibt fünf Angriffskategorien und zugehörige Abwehrmaßnahmen. Es empfiehlt dringend, die Autorisierung zu verwenden, wenn ein Server auf benutzerkontrollierte Daten zugreift (ob direkt oder über APIs), in Umgebungen mit strengen Zugriffskontrollen oder für Vorgänge wie Ratenbegrenzung, Nutzungsüberwachung und Audits. Der Haken daran: Die Nutzung dieser Sicherheitsebene ist optional. Dies lässt befürchten, dass viele MCP-fähige Interaktionen ohne jegliche Transparenz oder Kontrolle ablaufen werden.

Vor Kurzem wurde das MCP-Projekt um ein Register ergänzt, das die Auffindbarkeit verschiedener öffentlicher MCP-Server erleichtert. Die meisten Unternehmen werden jedoch private Unterregister anlegen, welche die Server einschränken, mit denen sich Clients überhaupt verbinden dürfen. Solche privaten Unterregistrierungen können Sicherheitsscans und Schwachstellenprüfungen beinhalten, um sicherzustellen, dass Clients nur mit zugelassenen und risikoadäquaten Servern interagieren. Es ist jedoch festzuhalten, dass weder das oberste Register noch die öffentlichen oder privaten Unterregister die durch Integrität geschützten Sicherheitskontrollen – wie digitale Signaturen oder Validierungslogik – durchsetzen können. Diese könnten aber zu einem späteren Zeitpunkt noch integriert werden.

Den Weg zu mehr MCP-Sicherheit ebnen

Um KI-Agenten erfolgreich in Arbeitsabläufe zu integrieren, ist es unerlässlich, die notwendigen Vorkehrungen zu treffen und MCP-bezogene Risiken von vornherein auszuschließen. Zahlreiche Leitfäden bieten Empfehlungen für die sichere Entwicklung und Bereitstellung von MCP an. Hierbei sind insbesondere die vom MCP-Projekt selbst vorgeschlagenen Best Practices und die OWASP Top 10 für MCP empfehlenswert, da beide umfassend sind und detaillierte Schritte zur Risikominderung enthalten.

Gut konzipierte MCP-Server bieten eine zusätzliche, wertvolle Sicherheitsebene für die von ihnen bereitgestellten Datenquellen. Sie leisten folgendes:

- Zentralisierung des Zugriffs auf mehrere Datenquellen, indem sie Authentifizierung, Autorisierung, Datenmaskierung und geeignete Abrufmöglichkeiten hinzufügen, selbst wenn die Quellen diese Funktionen nicht besitzen.

- Funktion als Gateways zu APIs, indem sie Authentifizierung, Formatierung und Tokenisierung verwalten, selbst wenn die zugrunde liegenden APIs diese Funktionen nicht bieten.

- Verbesserung des Datenschutzes und der Compliance durch die Kontrolle des Zugriffs und die Überwachung von Aktivitäten, selbst wenn Anwendungen dies nicht selbst leisten können.

Dennoch fehlt dem MCP eine native Richtlinienebene: Es ist nicht in der Lage, Transparenz, Durchsetzung oder Governance der Datenflüsse zu gewährleisten. Dieser Mangel wiegt besonders schwer, da nicht jeder Aspekt des MCP unter vollständiger Kontrolle bleibt. Einige der Tausenden öffentlich zugänglichen MCP-Server könnten reizvoll sein, da sie einen Mehrwert bieten können, wenn sie mit Unternehmensdaten verbunden werden und autonome Operationen ausführen dürfen. Glücklicherweise bieten AI-Sicherheitsanbieter mittlerweile Produkte an, die diese fehlende Richtlinienebene hinzufügen, wodurch die sichere Integration öffentlicher Server möglich wird. Es sollte auf Produkte bestanden werden, die folgende Funktionen bieten, und diese sind gründlich zu prüfen:

- Kontinuierliche und Echtzeit-Identifizierung von MCP-Servern und Clients, die in der Organisation verwendet werden, einschließlich aller Attribute wie Name, ID, URL, Version, Host, Datenquelle und Protokoll.

- Anwendung einer Risikobewertung auf MCP-Servern, um schnell beurteilen und priorisieren zu können, welche KI-Tools, Agenten oder Integrationen die größten Sicherheits- und Compliance-Risiken darstellen.

- Verwaltung des Zugriffs mithilfe granularer, kontextbasierter Richtlinienkontrollen (einschließlich einer Standard-Blockierungsoption für MCP-Datenverkehr) und Verhinderung von Datenlecks in Echtzeit.

- Erkennung und Überwachung des nicht-menschlichen Datenverkehrs zwischen und über MCP-Servern, Clients, Funktionen, Hosts, Datenquellen und Entwicklungstools hinweg.

- Protokollierung aller MCP-Ereignisse, einschließlich Sitzungen, Initialisierungen, Funktionsanforderungen und -antworten sowie Bereitstellungen.

- Bestimmung und Klassifizierung sensibler Daten, wie geistiges Eigentum und Passwörter, die mit MCP-fähigen Anwendungen verwendet werden.

Wie andere Arten von mehrschichtigen Kontrollen sind auch diese Produkte effektiv, da sie inline arbeiten und den gesamten MCP-Datenverkehr zwischen Clients und Servern sehen. Sie wenden die Richtlinien auf den Datenverkehr an, um sicherzustellen, dass Daten dorthin gelangen und bleiben, wo sie hingehören, und nicht dorthin, wo sie nicht hingehören. Es wird sogar vorgeschlagen, dass auch die Interaktionen zwischen internen Clients und Servern diese Inline-Richtlinienebene durchlaufen sollten.

Agentenbasierte KI macht den Unterschied

Wenn Unternehmen davon ausgehen – was bei den meisten der Fall ist –, dass agentenbasierte KI einen messbaren Mehrwert schaffen wird, sind gewisse Vorbereitungen zu treffen, bevor Hunderte von Agenten in den Produktionsbetrieb strömen. Es gilt, die Rolle des Sicherheitschampions einzunehmen: Es müssen die Leitfäden gelesen, Sicherheit in die MCP-Clients und -Server integriert und die erforderliche Richtlinienebene hinzugefügt werden. So lässt sich der Unternehmensleitung zeigen, dass sichere, agentenbasierte KI nicht nur möglich ist, sondern dem Unternehmen sogar einen echten Wettbewerbsvorteil verschafft.

Um einen Kommentar zu hinterlassen müssen sie Autor sein, oder mit Ihrem LinkedIn Account eingeloggt sein.