Die automatische Erkennung von Gesichtern ist inzwischen eine (fast) alltägliche Technologie, bei der Verfahren der Künstlichen Intelligenz (KI) eingesetzt werden. Es gibt dafür unterschiedliche Anwendungen, etwa die biometrische Einlasskontrolle, ein Müdigkeitswarner für Autofahrer*innen oder Vorhersagemodelle bei Besucher- oder Fahrgastströmen. Diese Anwendungen erfordern keine direkte Identifizierung der Person, sondern lediglich die Analyse bestimmter Merkmale oder Gesichtsausdrücke wie Anzeichen von Müdigkeit oder Angst.

Neuronale Netze für diese Anwendungen müssen mit Fotos von Menschen trainiert werden, damit sie die Gesichtsmerkmale später zuverlässig erkennen. Allerdings dürfen die Entwickler und Anbieter von KI-Anwendungen nicht einfach beliebige Fotos von Personen benutzen. Sie gehören zu den personenbezogenen Daten, die von der europäischen Datenschutzverordnung DSGVO besonders geschützt sind.

Privatsphäre und Anonymisierung von Personen

Es gibt in der DSGVO keine besonderen Regeln für Fotos, aber eine Reihe von allgemeinen Grundsätzen. Laut DSGVO müssen personenbezogene Daten rechtmäßig, transparent und zweckgebunden verarbeitet werden. Dafür ist eine Rechtsgrundlage notwendig, beispielsweise die Einwilligung der betroffenen Personen oder die Erfüllung eines Vertrags. Das ist allerdings eher im Sinne einer Ausnahme gemeint. Grundsätzlich gilt: Gespeicherte Gesichter auf Fotos oder Videos von allgemein zugänglichen Orten und öffentlichen Veranstaltungen müssen vor der Nutzung unkenntlich gemacht werden.

Denn die DSGVO räumt Unternehmen das Recht ein, anonymisierte Daten zu speichern und zu nutzen. Dabei wird der Personenbezug vollständig entfernt, so dass sie für statistische Auswertungen oder Forschungsprojekte genutzt werden können. Das gilt auch für Fotos oder Videos. Ein Beispiel: Ein Anbieter von Künstlicher Intelligenz möchte seine Software darauf trainieren, die Gesichtsausdrücke von Menschen zu erkennen, um in der Marktforschung das Einkaufsverhalten anhand von Videos analysieren zu können. Dafür wird er eine Vielzahl an Fotos benötigen, für die jede aufgenommene Person eine Einwilligung in die Nutzung abgeben muss – eine unrealistische Annahme. Deshalb müssen Fotos für KI-Training normalerweise anonymisiert werden.

Die klassische Methode ist der berühmte schwarze Balken über dem Gesicht. Er hat den Vorteil, dass er auch ohne Bildbearbeitungssoftware bereits mit einfachen Mitteln erzeugt werden kann. Etwas eleganter sehen Verpixelung oder Blurring (Verwischen) der Gesichter aus. Dafür ist Grafiksoftware notwendig, die zum Teil sogar mit Gesichtserkennung arbeitet und somit große Bildmengen schneller bearbeitet.

Diese Verfahren haben allerdings für das Training von KI-Anwendungen einen Nachteil: Soziologische Personenmerkmale wie Geschlecht, Alter, Blickrichtung oder Emotionen sind nicht mehr klar erkennbar. Als Folge sinkt die Datenqualität. Die herkömmlichen Anonymisierungsverfahren bewahren nicht die Genauigkeit und Integrität der Originaldaten. Doch genau das ist für KI und maschinelles Lernen wichtig: Nur hochwertige Daten können KI-Modelle präzise trainieren.

Anonymisierung mit künstlichen Gesichtern

Eine Alternative zu den traditionellen Methoden der Anonymisierung ist der Einsatz von künstlichen Gesichtern, die von neuronalen Netzen zur Bildverarbeitung erzeugt und über das originale Gesicht kopiert werden. Dieses Verfahren nutzt ein Generative Adversarial Network (GAN), um real aussehende Gesichter von nicht existierenden Personen zu erzeugen.

Eines der ersten Netze, das künstliche Gesichter erstellt hat, war StyleGAN2, dessen Ergebnisse auf der Website thispersondoesnotexist.com gezeigt werden. Bei jeder Aktualisierung der Site erscheint ein neues Gesicht. Auch wenn dieses nicht zur Anonymisierung eingesetzt werden kann, demonstriert es doch eindrücklich die technischen Möglichkeiten. Der größte Teil des Outputs wirkt verblüffend echt und ist nur im Einzelfall als künstliches Gesicht zu erkennen. Kleinere Fehler oder Unsauberkeiten beim Hintergrund sind bedingt durch das Alter des Netzes. Neuere GANs arbeiten deutlich besser und machen so gut wie keine Fehler mehr.

Mit solchen KI-Anwendungen können die künstlichen Gesichter erstellt werden, die dann echte Gesichter im Bild überlagern. Dabei bleiben alle wichtigen Merkmale erhalten: Alter, Geschlecht, die Farbe von Haut, Haaren und Augen sowie Blickrichtung und Gefühlsausdruck. Der durch den Austausch des Gesichtes entstehende Verfremdungseffekt führt dazu, dass die Person für menschliche und maschinelle Betrachter nicht mehr erkennbar ist. Eine nachträgliche Identifizierung ist ausgeschlossen. Zudem ist die Anonymisierung durch synthetische Gesichter nicht umkehrbar.

Das Anonymisierungsverfahren entspricht damit den Vorgaben des Datenschutzes, echte Personen sind auf den bearbeiteten Fotos nicht mehr erkennbar. Doch anders als bei bisherigen Anonymisierungsverfahren bleiben Gesichtsmerkmale und physische Attribute erhalten. Die anonymisierten Fotos sind deshalb auch zum Trainieren von Modellen für Machine Learning geeignet.

So funktioniert die Anonymisierung mit KI

Bevor ein Gesicht automatisiert unkenntlich gemacht werden kann, muss es zuerst entsprechend erkannt werden. Ein Detektionsmodell erfasst Gesichter und damit die genaue örtliche Zuordnung in einem Bild – oder in Videos in jedem einzelnen Frame. An dieser Stelle setzen dann die üblichen Anonymisierungsmethoden ihren Filter an und machen so das Gesicht unkenntlich und für jede weitere Analyse unbrauchbar. Um ein künstlich generiertes Gesicht als eine Art Maske auf das originale Gesicht zu setzen, sind weitere KI-Modelle im Einsatz.

Zunächst müssen die vorab als relevant definierten Attribute des identifizierten Gesichts erkannt werden. Eine entsprechende KI analysiert auf diese Weise unter anderem das Alter, Geschlecht, die Farbe der Haut und sogar die Mimik. Mit diesen Attributen wird dann ein entsprechendes GAN versorgt. Dieses generiert dann ein künstliches Gesicht, das zum einen die zuvor erfassten Attribute berücksichtigt und zum anderen möglichst große Unterschiede zum Original aufweist. Diese beiden Parameter liegen dem GAN zugrunde, um die Anonymisierung der Personen zu garantieren und die relevanten Informationen zu erhalten.

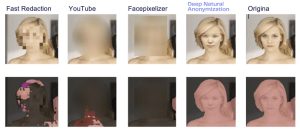

BU: Bilder und ihre Segmentierungskarten bei verschiedenen Anonymisierungsverfahren

Die Abbildung zeigt Beispiele für Segmentierungskarten mithilfe von Googles Deepmind (unten) anhand unterschiedlicher Rohdaten (oben). Die ersten drei Spalten zeigen die Bilder und Segmentierungskarten von Gesichtern, die mit einfachen Algorithmen anonymisiert wurden. Der Unterschied zwischen Originalbild (rechts) und der Anonymisierung mit einem KI-generierten künstlichen Gesicht ist eindeutig zu sehen, jedoch ist die Person noch immer als Frau klar erkennbar. Die Segmentierungskarten zeigen viele Ähnlichkeiten, die Physiognomie des Originalgesichts bleibt erhalten, was die rosa Farbe zeigt. Bei den anderen Verfahren kann eine KI den Input nicht mehr als Mensch, geschweige denn als Frau erkennen – bei der Anonymisierung von YouTube wird sogar eine Katze auf dem Bild vermutet (braun).

Das künstliche Gesicht eignet sich also für weitergehende Analysen. Doch es ist im Vergleich zum Original „entindividualisiert“ und nicht mehr als die Schauspielerin Reese Witherspoon erkennbar. Deshalb ist das künstliche Gesicht DSGVO-konform, erhält aber trotzdem die Datenqualität des Originals.

Die innovative Methode zur Anonymisierung von personenbezogenen Daten bietet einen hohen Schutz der Privatsphäre. Der Umgang mit personenbezogenen Daten sollte von Unternehmen ernst genommen werden. Bei Verstößen gegen die DSGVO drohen Geldstrafen, der Verlust des Kundenvertrauens und eine Schädigung des Rufs und der Marke. Der Ersatz von echten durch künstliche Gesichter ist eine gute Möglichkeit, personenbezogene Daten zu anonymisieren und gleichzeitig hochwertige Trainingsdaten für KI-Modelle zu erhalten.

Um einen Kommentar zu hinterlassen müssen sie Autor sein, oder mit Ihrem LinkedIn Account eingeloggt sein.